Inference-Time Scaling for Generalist Reward Modeling

27배 더 작은 AI가 더 많이 '생각'하면 대형 모델을 이긴다: 추론 시간 확장성의 원리

대규모 언어 모델(LLM, Large Language Model)의 후속 훈련 과정에서 강화학습(RL, Reinforcement Learning)이 널리 사용되고 있다. 특히 딥시크(DeepSeek-AI)나 오픈AI(OpenAI) 같은 기업들은 대규모 언어 모델의 성능 향상을 위해 강화학습을 적극적으로 활용하고 있다. 이러한 강화학습의 핵심 구성 요소인 보상 모델링(Reward Modeling)은 언어 모델의 응답에 대한 정확한 보상 신호를 생성하는 역할을 한다. DeepSeek-AI와 칭화대학교의 공동 연구에 따르면, 추론 시간 동안 고품질의 보상 신호를 생성하는 것이 언어 모델의 성능을 크게 향상시킬 수 있다는 사실이 밝혀졌다.

그러나 현재 대부분의 고품질 보상 신호는 수학 문제나 코딩 작업과 같이 명확한 정답이 있는 한정된 도메인에서만 효과적으로 생성되고 있다. 일반적인 영역에서는 보상 생성이 더 복잡하고 다양한 기준이 필요하며, 명시적인 참조나 정답이 없는 경우가 많아 어려움이 따른다. 따라서 보다 일반적인 영역에서도 효과적인 보상 모델링 방법이 필요하다.

이번 연구에서는 일반화된 보상 모델링(Generalist Reward Modeling)을 위한 추론 시간 확장성(Inference-Time Scalability)을 개선하는 방법을 조사했다. 추론 시간 확장성이란 더 많은 추론 연산을 사용함으로써 보상 신호의 품질을 향상시키는 능력을 의미한다. 연구진들은 언어 표현만으로 단일, 쌍, 다중 응답의 평가를 통합할 수 있는 포인트와이즈 생성 보상 모델링(Pointwise Generative Reward Modeling) 접근법을 채택했다.

"AI에게 원칙을 가르치자": 자기 원칙 비평 튜닝으로 90.4%의 정확도 달성

연구진은 보상 모델의 확장성을 개선하기 위해 '자기 원칙 비평 튜닝'(SPCT, Self-Principled Critique Tuning)이라는 새로운 학습 방법을 제안했다. SPCT는 온라인 강화학습을 통해 생성 보상 모델(GRM)에서 확장 가능한 보상 생성 행동을 촉진하여 원칙을 적응적으로 생성하고 비평을 정확하게 수행한다. SPCT는 두 단계로 구성된다. 첫 번째는 거부 미세 조정(Rejective Fine-Tuning) 단계로, 보상 모델이 다양한 입력 유형에 대해 올바른 형식의 원칙과 비평을 생성하도록 적응시킨다. 두 번째는 규칙 기반 온라인 강화학습 단계로, 보상 모델이 입력 쿼리와 응답에 따라 적응적으로 원칙과 비평을 생성하는 방법을 학습한다.

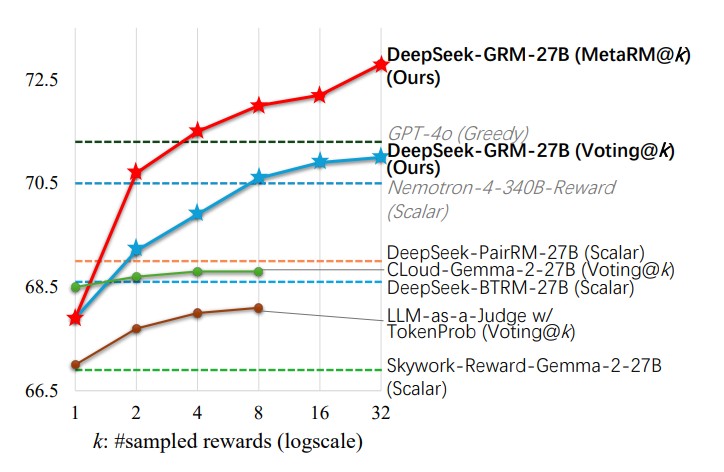

이러한 방법론을 통해 DeepSeek-GRM이라는 보상 모델을 개발했다. 추론 시간 확장성을 위해 병렬 샘플링을 사용하여 계산 사용량을 확장하고, 메타 보상 모델(Meta RM)을 도입하여 투표 과정을 안내함으로써 확장 성능을 향상시켰다.

병렬 샘플링의 마법: 8개 샘플만으로 최고 성능 구현

DeepSeek-GRM은 병렬 샘플링을 통해 다양한 원칙과 비평을 생성하고, 이를 바탕으로 최종 보상을 투표한다. 더 큰 규모의 샘플링을 통해 DeepSeek-GRM은 더 높은 다양성을 가진 원칙에 기반하여 더 정확한 판단을 내리고, 더 세밀한 보상을 출력할 수 있게 된다. 메타 보상 모델(Meta RM)은 투표 과정을 안내하기 위해 훈련된 포인트와이즈 스칼라 보상 모델이다. 이 모델은 DeepSeek-GRM이 생성한 원칙과 비평의 정확성을 확인하고, 이진 교차 엔트로피 손실(Binary Cross-Entropy Loss)로 훈련된다. 메타 보상 모델은 각 샘플의 메타 보상을 출력하고, 최종 결과는 상위 메타 보상을 가진 샘플들의 투표로 결정된다.

연구팀은 경험적 실험을 통해 SPCT가 생성 보상 모델(GRM)의 품질과 확장성을 크게 향상시키고, 다양한 보상 모델링 벤치마크에서 기존 방법과 모델을 능가하는 성능을 보여준다는 것을 확인했다. 이는 심각한 편향 없이 도메인 일반화 능력을 보여주는 것이다.

대형 모델보다 효과적인 대안: 32샘플 투표로 671B 모델과 동등한 성능 구현

연구진은 추가적으로 DeepSeek-GRM-27B의 추론 시간 및 훈련 시간 확장 성능을 조사했다. 다양한 크기의 언어 모델에 SPCT 훈련 일정을 적용한 결과, 추론 시간 확장이 훈련 시간에서의 모델 크기 확장보다 더 효과적일 수 있다는 것을 발견했다. 실험 결과에 따르면, DeepSeek-GRM-27B의 32개 샘플을 이용한 직접 투표는 671B 파라미터 크기의 모델과 비슷한 성능을 달성할 수 있었고, 메타 보상 모델이 안내하는 투표는 8개 샘플만으로도 최상의 결과를 달성했다. 이는 모델 크기를 확장하는 것보다 추론 시간을 확장하는 것이 DeepSeek-GRM-27B에서 더 효과적임을 보여준다.

더불어 연구팀은 DeepSeek-R1에 대한 테스트도 수행했는데, 그 성능이 236B 모델보다도 낮다는 것을 발견했다. 이는 추론 작업에 대한 긴 체인 오브 소트(Chain-of-Thoughts)를 확장하는 것이 일반화된 보상 모델의 성능을 크게 향상시키지 못한다는 것을 시사한다.

미래의 보상 모델: 도구 통합과 프로세스 개선으로 효율성 극대화

SPCT는 생성 보상 모델(GRM)의 성능과 추론 시간 확장성을 크게 향상시키고 일반 도메인에서 스칼라 및 세미 스칼라 보상 모델을 능가하지만, 몇 가지 한계점이 있다. 생성 보상 모델의 효율성은 동일한 규모의 스칼라 보상 모델보다 상당히 뒤처지며, 이는 온라인 강화학습 파이프라인에서의 대규모 사용을 저해한다. 또한 검증 가능한 작업과 같은 특정 도메인에서는 DeepSeek-GRM이 여전히 스칼라 모델보다 뒤쳐진다. 스칼라 보상 모델은 추론 쿼리와 응답의 숨겨진 특징을 포착할 수 있지만, 생성 보상 모델은 응답을 철저히 검토하기 위해 더 강력한 추론 능력이 필요하기 때문이다.

향후 연구 방향으로는 보상 모델에 도구를 통합하거나, 원칙과 비평 생성을 별도의 단계로 분해하는 방법, 그리고 LLM 오프라인 평가에 DeepSeek-GRM을 활용하는 방법 등이 제시되었다. 또한 DeepSeek-GRM은 긴 체인 오브 소트 추론을 통해 혜택을 받을 수 있지만, 이는 효율성에 더 영향을 미칠 수 있어 향후 연구에서 검토해야 할 부분이다.

FAQ

Q: 일반화된 보상 모델링이란 무엇이며 왜 중요한가요?

A: 일반화된 보상 모델링은 다양한 도메인에서 언어 모델의 응답에 대한 정확한 보상 신호를 생성하는 기술입니다. 이는 명확한 정답이 없는 일반적인 영역에서도 언어 모델의 성능을 향상시키기 위해 중요합니다. 기존의 보상 모델은 수학이나 코딩 같은 정해진 영역에서만 효과적이었지만, 일반화된 보상 모델링을 통해 더 넓은 응용 분야에서 언어 모델의 성능을 개선할 수 있습니다.

Q: 자기 원칙 비평 튜닝(SPCT)은 어떻게 작동하나요?

A: SPCT는 두 단계로 작동합니다. 첫째, 거부 미세 조정 단계에서는 보상 모델이 다양한 입력 유형에 대해 올바른 형식의 원칙과 비평을 생성하도록 적응시킵니다. 둘째, 규칙 기반 온라인 강화학습 단계에서는 모델이 입력 쿼리와 응답에 따라 적응적으로 원칙과 비평을 생성하는 방법을 학습합니다. 이를 통해 모델은 다양한 도메인에서 보다 정확하고 유연한 보상을 생성할 수 있게 됩니다.

Q: 추론 시간 확장성이 모델 크기 확장보다 왜 효과적인가요?

A: 추론 시간 확장성은 모델 크기를 증가시키지 않고도 더 많은 계산 자원을 활용하여 성능을 향상시키는 방법입니다. 연구 결과에 따르면, 27B 파라미터 크기의 DeepSeek-GRM 모델에 32개의 병렬 샘플링을 적용하면 671B 파라미터 크기의 모델과 비슷한 성능을 달성할 수 있었습니다. 이는 모델 크기를 늘리는 대신 추론 시간에 더 많은 자원을 투입하는 것이 비용 효율적이고 실용적인 성능 향상 방법임을 보여줍니다.

해당 기사에서 인용한 논문 원문은 링크에서 확인할 수 있다.

이미지 출처: 이디오그램 생성

기사는 클로드와 챗GPT를 활용해 작성되었습니다.

AI Matters 뉴스레터 구독하기

![[시승기] 국내 출시 임박 ‘지커 7X’…암스테르담 시승으로 완성도 살펴보니](http://img.danawa.com/new/mdnw/dpg/img/img_n208_1.png) [

[

진

진